8.5.0

Mit der Aktion Prompt-Abfrage kann innerhalb eines Workflows eine zuvor konfigurierte KI-Abfrage ausgeführt werden. Die Aktion greift auf eine im Backend angelegte Prompt-Konfiguration zu und verarbeitet deren Ergebnis im weiteren Workflow.

Inhalt

|

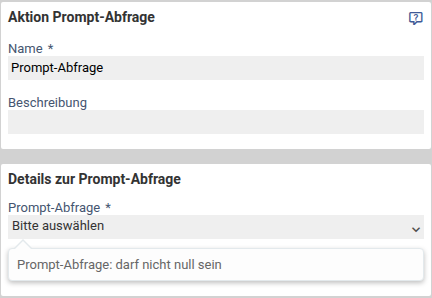

Konfiguration

Name

Interne Bezeichnung der Workflow-Aktion. Der Name dient der besseren Übersicht, insbesondere bei komplexeren Workflows mit mehreren Aktionen.

Beschreibung

Optionales Feld zur Dokumentation des Einsatzzwecks innerhalb des Workflows. Hier kann festgehalten werden, welche Aufgabe die Prompt-Abfrage erfüllt oder welche Daten verarbeitet werden.

Prompt-Abfrage

Hier wird eine zuvor angelegte Prompt-Konfiguration ausgewählt. Zur Auswahl stehen alle im System definierten Prompt-Abfragen.

Die ausgewählte Konfiguration bestimmt:

- welches Modell verwendet wird

- welche Eingaben verarbeitet werden

- in welchem Format die Antwort zurückgegeben wird

Verarbeitung von Parametern

Die Prompt-Abfrage verarbeitet die in der Konfiguration definierten Eingabeparameter.

Werte können z.B. stammen aus:

- Formularfeldern

- Workflow-Variablen-Dateiuploads

Die Parameter werden beim Ausführen automatisch an das Modell übergeben.

Rückgabewerte bei erfolgreicher Ausführung

Nach erfolgreicher Ausführung der Prompt-Abfrage stellt die Workflow-Aktion verschiedene Platzhalter zur Verfügung. Diese enthalten das vom Modell erzeugte Ergebnis sowie Informationen zur Nutzung des Modells.

Antworttext

[%$Prompt-Abfrage.RESULT.responseData.answer%]

Enthält die generierte Antwort des Modells. Je nach Konfiguration kann dies ein Freitext, eine strukturierte JSON-Antwort oder das Ergebnis einer Klassifikation sein. Der Inhalt entspricht genau dem Ausgabeformat der gewählten Prompt-Konfiguration.

Token-Nutzung (input)

[%$Prompt-Abfrage.RESULT.responseData.tokenUsage.input%]

Gibt an, wie viele Tokens für die Eingabe verarbeitet wurden. Dazu zählen der Prompt, übergebene Parameter sowie ggf. Systemanweisungen.

Token-Nutzung (output)

[%$Prompt-Abfrage.RESULT.responseData.tokenUsage.output%]

Zeigt, wie viele Tokens für die generierte Antwort verwendet wurden.

Token-Nutzung (gesamt)

[%$Prompt-Abfrage.RESULT.responseData.tokenUsage.total%]

Enthält die Gesamtzahl der verwendeten Tokens (Eingabe+Ausgabe). Dieser Wert ist insbesondere relevant für Monitoring, Kostenkontrolle oder statistische Auswertungen.

Die Rückgabewerte stehen unmittelbar nach der Aktion zur Verfügung und können flexibel im weiteren Workflow verarbeitet oder gespeichert werden.

Fehlerwerte bei fehlgeschlagener Ausführung

Wird die Prompt-Abfrage nicht erfolgreich ausgeführt, stellt die Workflow-Aktion zusätzliche Fehler-Platzhalter bereit. Diese können für Protokollierung, Benachrichtigungen oder alternativen Workflow-Zweige verwendet werden.

PROMPT_SERVICE_NOT_FOUND

[%$Prompt-Abfrage.ERROR.promptType%]

Dieser Fehler tritt auf , wenn der konfigurierte Prompt-Dienst nicht gefunden oder nicht verfügbar ist.

Mögliche Ursachen:

- Der Dienst wurde nicht korrekt eingerichtet

- Die Verbindung oder Authentifizierung zum Anbieter ist ungültig

Der Platzhalter enthält den betroffenen Diensttyp.

REQUEST_REFUSED

[%$Prompt-Abfrage.ERROR.refusalREASON%]

Dieser Fehler wird gesetzt, wenn die Anfrage vom KI-Dienst abgelehnt wurde, bevor eine Antwort generiert werden konnte.

Typische Gründe:

- Der übergebene Inhalt verstößt gegen Richtlinien

- Die Anfrage ist unzulässig oder unvollständig

- Sicherheits- oder Schutzmechanismen greifen

Der Platzhalter enthält die vom Dienst zurückgegebene Ablehnungsbegründung.

RESPONSE_REFUSED

[%$Prompt-Abfrage.ERROR.refusalREASON%]

Wird gesetzt, wenn das Modell die Generierung einer Antwort verweigert. Auch hier enthält der Platzhalter die Begründung des Dienstes.

Hinweise zur Weiterverarbeitung

Die Fehler-Platzhalter stehen ebenfalls unmittelbar nach der Aktion zur Verfügung und können genutzt werden, um:

- einen alternativen Workflow-Zweig auslösen

- einen Status zu setzen

- eine interne Benachrichtigung mit Fehlerdetails zu versenden

- Fehlerprotokolle zu erzeugen

So lässt sich transparent nachvollziehen, warum eine Prompt-Abfrage nicht erfolgreich abgeschlossen wurde.

War dieser Artikel hilfreich?

Das ist großartig!

Vielen Dank für das Feedback

Leider konnten wir nicht helfen

Vielen Dank für das Feedback

Feedback gesendet

Wir wissen Ihre Bemühungen zu schätzen und werden versuchen, den Artikel zu korrigieren